cascad : une unité dédiée à la reproductibilité de la recherche scientifique en économie

#ZOOM SUR…

Professeur d’économie à l’université d’Orléans, Christophe Hurlin est spécialisé en économétrie financière et gestion des risques. Professeur de finance à HEC Paris, Christophe Pérignon conduit des recherches sur la gestion des risques financiers et l’utilisation de la science des données en finance. Tous deux ont fondé le service d’archivage de données et de codes scientifiques RunMyCode.org et, en partenariat avec le CNRS, la première agence de certification de la reproductibilité de la recherche scientifique — Certification agency for scientific code and data (cascad, UAR2007, CNRS / HEC Paris / Université d’Orléans) —, dont ils sont respectivement directeur adjoint et directeur.

En 1933, Ragnar Frisch, premier prix Nobel d’économie et premier éditeur de la prestigieuse revue Econometrica, écrivait dans le volume inaugural de la revue : "in Econometrica the original raw data will, as a rule, be published, unless their volume is excessive. This is important in order to stimulate criticism, control, and further studies”. Ce principe visionnaire de mise à disposition systématique des données mettait très tôt l’économie sur la voie de la science ouverte et reproductible. Cependant, quatre-vingt-dix ans plus tard, le verre reste à moitié vide. En effet, de nombreux résultats publiés en économie ne peuvent pas être regénérés par d’autres chercheurs. Par exemple, Chang et Li1 indiquent que seul un article sur trois peut être reproduit dans un échantillon incluant uniquement des articles récemment publiés dans des revues d’économie parmi les plus prestigieuses.

Définition de la reproductibilité

Avant d’essayer de comprendre pourquoi l’économie peine à être reproductible, commençons par clarifier la terminologie. Il existe en effet une certaine confusion entre les termes « reproductibilité », « réplication » et « robustesse ». Cette ambiguïté est renforcée par le fait que les définitions utilisées sont souvent contingentes aux disciplines computationnelles considérées2 . Dans un effort de clarification, l’Académie américaine des sciences, d’ingénierie et de médecine3 a récemment proposé de qualifier un article de « reproductible » si les auteurs fournissent toutes les données et les codes informatiques nécessaires pour refaire exactement la même analyse et obtenir les mêmes résultats. L’idée de la reproductibilité peut ainsi se résumer par l’équation « mêmes données + même méthode = mêmes résultats ». De façon distincte, une étude de « réplication » est menée à partir de nouvelles données/expériences ou peut être implémentée avec d’autres méthodologies. Ainsi, la réplication se résume à « nouvelles données et/ou nouvelles méthodes dans une étude indépendante = globalement mêmes résultats ».

Les raisons d’une faible reproductibilité en économie

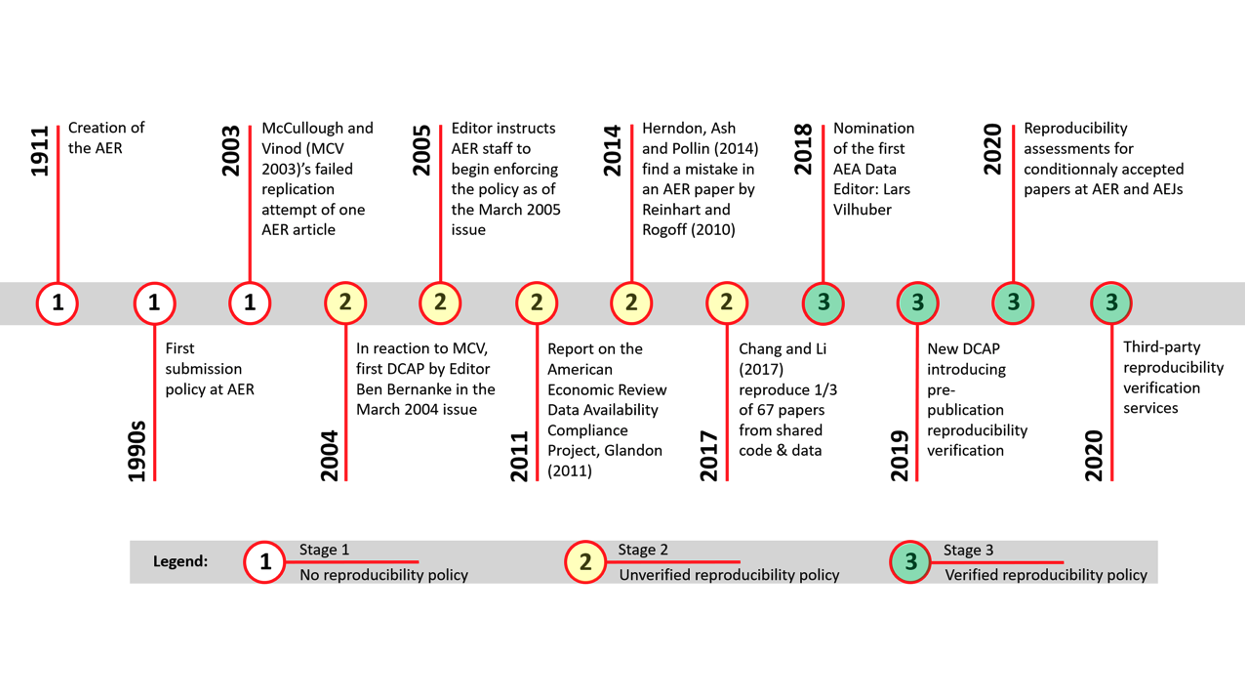

Comme l’indique sa définition, la reproductibilité apparaît donc comme une propriété peu exigeante d’un point de vue scientifique. Alors, comment expliquer que les articles publiés en économie restent encore aujourd’hui largement non reproductibles ? Les raisons invoquées sont nombreuses. Pour commencer, les revues scientifiques n’ont pas toutes une politique de partage des codes et des données (Data & Code Availability Policy ou DCAP), et cette dernière — quand elle existe — n’est pas systématiquement appliquée. En outre, l’exhaustivité et la qualité des ressources partagées par les auteurs ne sont que très rarement vérifiées. En effet, seule une dizaine de revues (sur plus de 1 000 en économie-gestion) conduisent des vérifications systématiques de la reproductibilité de tous les articles publiés. Dans le cas de l’American Economic Review (AER), cette politique de vérification systématique n’a été mise en place que très récemment, en 2019 (voir Figure 1). Un autre problème inhérent à la science économique est le recours fréquent à des données confidentielles comme les données fiscales, financières, de santé, etc., ou à des données secondaires achetées auprès de fournisseurs comme Bloomberg ou Thomson Reuters. Dans les deux cas, les données ne peuvent pas, pour des raisons contractuelles, être partagées librement avec d’autres chercheurs. De plus, certaines analyses requièrent des infrastructures de calcul particulières ou des logiciels propriétaires, ce qui rend difficile voire impossible leur reproduction. Enfin, les problèmes peuvent survenir à cause de bugs informatiques4 . Colliard, Hurlin et Pérignon5 démontrent que la nature biface du marché de la publication, avec d’un coté des chercheurs peu incités à rendre leurs recherches reproductibles faute de temps et de l’autre des revues en concurrence frontale les unes avec les autres, amène naturellement à un niveau de reproductibilité qui est socialement trop faible.

Pourquoi un niveau faible de reproductibilité est problématique ?

La reproductibilité est une condition nécessaire à la réfutabilité des résultats scientifiques numériques. Ainsi, sans les données originales de l’article de Reinhart et Rogoff6 , il aurait été impossible de détecter leurs erreurs et de remettre en cause leur résultat quant à l’existence d’un seuil de 90 % sur la dette publique au-delà duquel la croissance serait affectée. Par ailleurs, la mise à disposition systématique des données et des codes par les auteurs crée des incitations vertueuses. Le coût en termes de réputation pour les chercheurs de la détection d’une erreur dans leurs résultats, voire d’une rétractation de leur article, est tel que le seul fait d’exiger la mise à disposition des ressources numériques les incite à accroître sensiblement leurs efforts pour détecter ces erreurs.

Mais la question de la reproductibilité dépasse largement la seule problématique de la validation scientifique. Elle concerne également la diffusion des idées au sein de la communauté académique et au-delà. Ainsi, l’enjeu de la reproductibilité est devenu si important que la plupart des agences de financement de la recherche (Agence nationale de la recherche, European Research Council, National Science Foundation, etc.) ont mis en place des plans de gestion des données pour les projets qu’elles financent. Dans cette perspective, la reproductibilité est liée à la problématique du transfert technologique et s’inscrit dans le débat beaucoup plus large portant sur la science ouverte.

Le rôle-clé des revues académiques

Que faire pour améliorer la situation de cette discipline ? En économie, plusieurs associations scientifiques (l’American Economic Association, la Royal Economic Society et, très récemment, l’Econometric Society) ont nommé des éditeurs de données (data editors) afin de vérifier la reproductibilité des résultats des articles acceptés par les revues dont elles ont le contrôle (American Economic Review, Economic Journal, Econometrica, etc.) Afin de bien appréhender cette évolution, il est important de comprendre que :

- il s’agit d’un phénomène récent initié en 2018 par l’American Economic Association (voir Figure 1) ;

- cette augmentation des exigences en matière de vérification ne concerne pour l’instant que quelques revues parmi les plus prestigieuses en économie ;

- le phénomène est beaucoup moins développé dans les sciences de gestion.

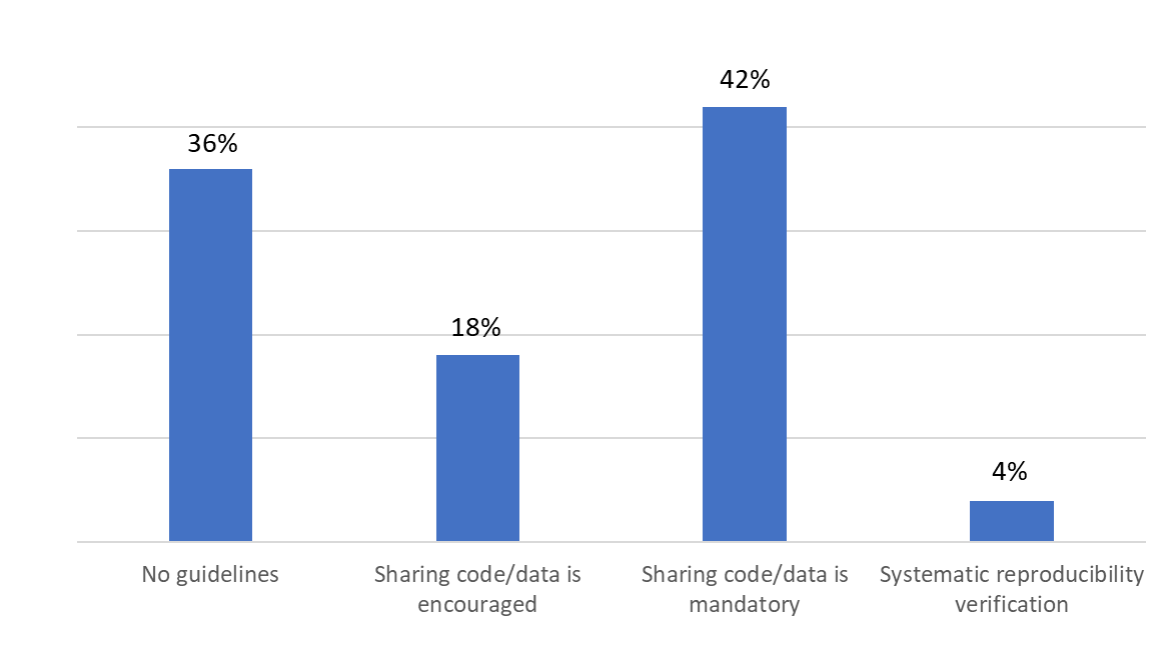

Afin d’illustrer cette situation, la Figure 2 présente une répartition des cinquante revues en économie-gestion incluses dans la liste du Financial Times par type de politique de reproductibilité. Nous voyons qu’aujourd’hui près de la moitié des revues de la liste ont mis en place une politique obligatoire de partage des codes et des données (avec exemption possible pour les données confidentielles) et que seules 4 % d’entre elles procèdent à une vérification de la reproductibilité des résultats avant publication.

Le principe de la certification cascad

Afin de promouvoir la reproductibilité en économie, l’unité cascad (Certification Agency for Scientific Code and Data) a été créée en partenariat avec le CNRS, HEC Paris et l’université d’Orléans, avec la volonté d’en faire la première agence de certification de la reproductibilité des publications académiques. Cette agence s’adresse non seulement aux chercheurs individuels, mais également à tous les acteurs institutionnels de la recherche (journaux, universités, agences de financement de la recherche, fournisseurs de données) désireux de s’assurer que la recherche qu’ils publient/produisent/financent est effectivement reproductible.

Le principe de la certification cascad est de garantir la reproductibilité des résultats numériques d’une publication scientifique à partir d’un ensemble de ressources numériques mis à disposition par le chercheur. Cette certification est attribuée à l’issue d’un processus d’évaluation en deux étapes. La première étape consiste à vérifier si les auteurs ont respecté les recommandations de l’agence visant à faciliter la reproduction des résultats de leur étude. Ces consignes concernent la présentation et la structure du code, la description des données, les métadonnées, etc. La seconde étape demande une évaluation détaillée de la reproductibilité menée par un rapporteur expert du logiciel utilisé par les auteurs, sous la supervision d'un éditeur spécialiste du domaine scientifique en question. Les tâches du rapporteur consistent à exécuter le code, à comparer les résultats obtenus avec ceux présentés dans l'article, à dresser la liste des potentielles divergences, et à rédiger un rapport d’exécution. À la fin du processus de certification, l’auteur reçoit un certificat de reproductibilité pour son article ou son document de travail, accompagné d’un rapport d’exécution décrivant de façon exhaustive toutes les étapes effectuées et, le cas échéant, les problèmes rencontrés. Le rapport peut être ajouté au manuscrit lors d’une soumission à un journal scientifique afin de signaler le caractère reproductible de la recherche et, potentiellement, d’augmenter les chances de publication.

Le cas des données confidentielles

Comme indiqué plus haut, l'utilisation de données confidentielles constitue un obstacle majeur à la mise en œuvre de la recherche reproductible7 . En cas d’utilisation de données confidentielles, il devient impossible pour un autre chercheur de reproduire les résultats d’un article scientifique à moins qu'il ne puisse accéder aux mêmes données non partageables.

Dans un article de Pérignon & al.8 , les auteurs montrent comment la certification de reproductibilité peut être étendue à des recherches fondées sur des données confidentielles. Par définition, l'accès aux données confidentielles est limité aux seuls utilisateurs accrédités. Ces derniers doivent suivre une procédure d'accréditation spécifique, parfois longue et fastidieuse, pour chaque fournisseur de données confidentielles. Dans ce contexte, une agence de certification externe constitue une solution naturelle. En tant que tiers de confiance, l'agence de certification peut être directement accréditée par les fournisseurs de données confidentielles et réaliser le travail d’évaluation de la reproductibilité pour un grand nombre de journaux.

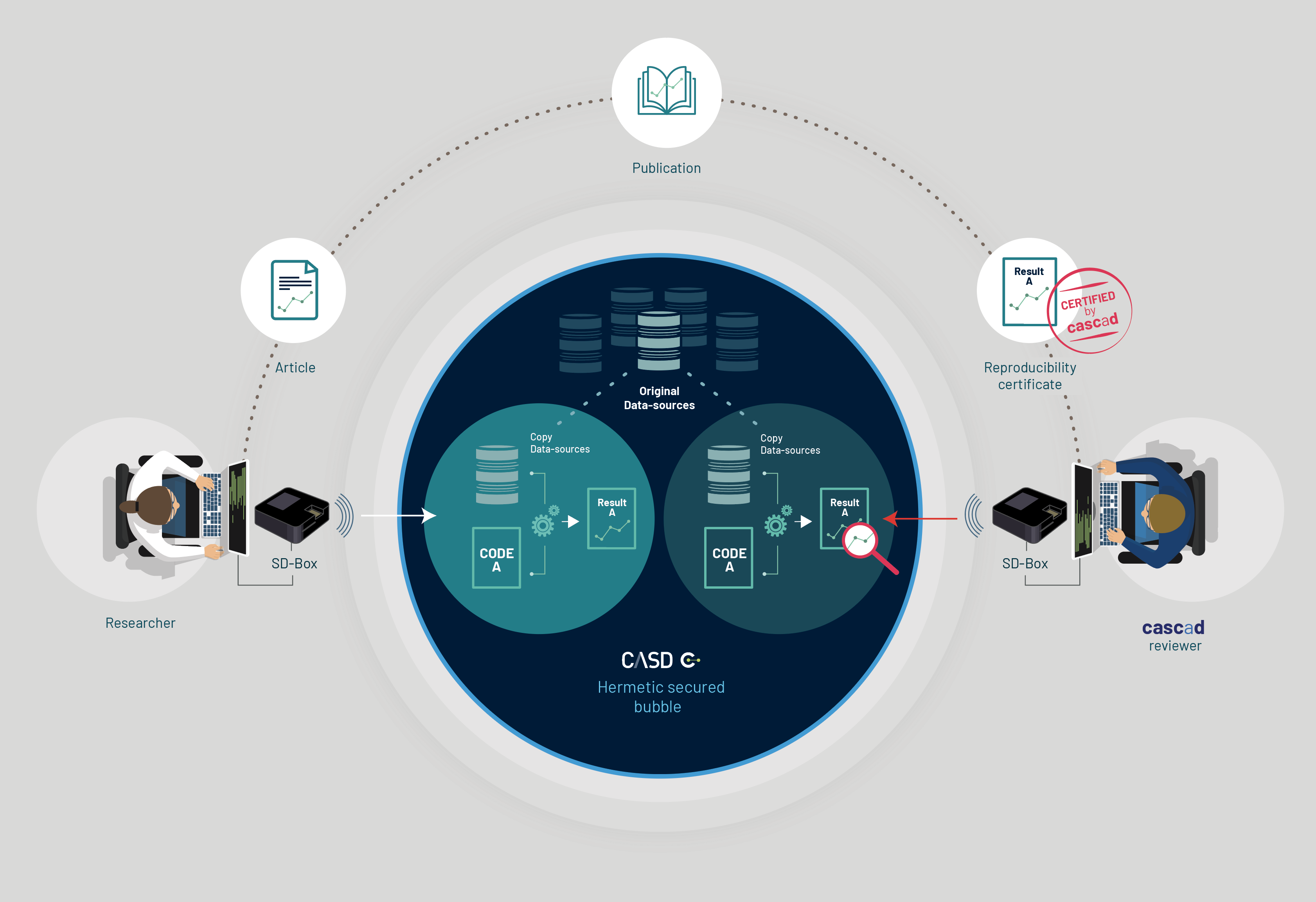

La première mise en œuvre du dispositif a eu lieu en 2018 grâce à un partenariat entre cascad et le Centre d'Accès Sécurisé aux Données (CASD). Le CASD est une infrastructure de recherche publique permettant aux chercheurs et chercheuses d'accéder aux données individuelles de l’INSEE, ainsi que d’un grand nombre d’administrations publiques (près de 300 sources au total). Le CASD autorise l'accès à distance aux données grâce à un dispositif protégé par les empreintes digitales installé sur le lieu de travail de l'utilisateur. Ce dispositif permet à l'utilisateur d’atteindre une bulle sécurisée dédiée dans laquelle un ensemble de données spécifiques peut être analysé à l'aide de logiciels statistiques préinstallés. Pour chaque projet de recherche, l'accès aux données nécessite l'approbation formelle du Comité du secret statistique français.

Afin de garantir une confidentialité absolue, chaque certification cascad est effectuée par un seul examinateur dans une bulle sécurisée contenant une copie des données brutes utilisées par les chercheurs (voir Figure 3). Dans la mesure où le CASD est également hébergeur de données de santé, de justice, ainsi que de données de réseaux sociaux, les perspectives de recherche et de vérification de leur reproductibilité sont très nombreuses et couvrent de multiples champs disciplinaires.

Un tiers de confiance

Depuis 2019, cascad intervient en tant que tiers de confiance (third party verificator) auprès d’une douzaine de revues d’économie afin d’évaluer la reproductibilité des articles conditionnellement acceptés pour publication (American Economic Review, American Economic Journal, Economic Journal, etc.) Les data editors de ces journaux sollicitent cascad lorsque les recherches sont basées sur des données confidentielles9 ou lorsqu’ils n’ont pas toutes les ressources ou l’expertise nécessaires afin de faire la vérification. Outre en économie, la certification cascad est maintenant reconnue et demandée par des revues en sciences politiques ou en statistiques.

- 1Chang A.C., Li P. 2017, A preanalysis plan to replicate sixty economics research papers that worked half of the time, American Economic Review: P&P, 107 (5): 60–64.

- 2Pour une typologie voir : Barba L.A. 2018, Terminologies for reproducible research, arXiv:1802.03311.

- 3National Academies of Sciences, Engineering, and Medicine, 2019, Reproducibility and replicability in science, The National Academies Press.

- 4Voir à ce sujet : Pérignon C., Akmansoy O., Hurlin C., Menkveld A., Dreber A., Holzmeister F., Huber J., Johannesson M., Kirchler M., Razen M., Weitzel U. 2023, Computational reproducibility in finance: Evidence from 1,000 tests, Document de travail, SSRN. https://papers.ssrn.com/sol3/papers.cfm?abstract_id=4064172

- 5Colliard J.-E., Hurlin C., Pérignon C. 2023, The economics of computational reproducibility, Document de travail, SSRN.

- 6Reinhart C. M., Rogoff K. S. 2010, Growth in a time of debt, American Economic Review, 100 (2):573-578.

- 7Christensen G.S., Miguel E. 2018, Transparency, reproducibility, and the credibility of economics research, Journal of Economic Literature, 56 (3):920-980.

- 8Pérignon C., Gadouche K., Hurlin C., Silberman R., Debonnel E. 2019, Certifying reproducibility with confidential data, Science, 365: 6449, 12 July, 127-128.

- 9Vilhuber L. 2023, Report of the AEA data editor, American Economic Review: P&P, 113:850-863.