Voir pour mieux entendre

La parole est perçue non seulement au travers de l’audition mais aussi de la vision. Coordonnée par Marc Sato, chargé de recherche CNRS au Laboratoire Parole et Langage (LPL, UMR7309, CNRS / AMU), une étude en électro-encéphalographie démontre que la durée visuelle des mouvements articulatoires d’un locuteur, précédant le signal acoustique de parole, influence de manière quasi-linéaire les temps de reconnaissance et traitements neuraux auditifs subséquents. Les résultats de cette étude, parus dans la revue Brain and Language, soulignent de manière claire la mise en œuvre de mécanismes prédictifs et la complémentarité des signaux acoustique et visuel lors de la perception de la parole.

De l'enfance à l'âge adulte, l'exploitation des régularités et complémentarités entre signaux acoustique et visuel de parole est un mécanisme clé dans le décodage des indices phonétiques pertinents et, de là, dans la compréhension du message linguistique. De nombreuses études démontrent ainsi que l'ajout au signal acoustique de parole des mouvements visuels articulatoires du locuteur permet d’améliorer l'identification des phonèmes et la reconnaissance des mots.

Les mécanismes neuraux à la base de ces avantages visuo-auditifs sont précisés par des études en électro- et magnéto-encéphalographie démontrant l’influence des mouvements visuels articulatoires pré-phonatoires précédant le signal acoustique de parole sur les traitements neuraux auditifs subséquents. Plus précisément, l'activité électrique des régions auditives classiquement impliqués dans les processus de décodage acoustico-phonétique apparait facilitée lors de la perception audiovisuelle par rapport à la perception auditive de la parole. Ces effets visuo-auditifs dépendent du degré de saillance visuelle, cette facilitation étant d'autant plus forte que la reconnaissance visuelle est élevée. En s'appuyant sur la rythmicité naturelle de la parole, il a également été montré que les mouvements visuels pouvaient, de manière prédictive et sélective, réinitialiser les réponses neurales dans le cortex auditif et que cette modulation d’activité reflétait des processus d'analyse temporelle, de segmentation et d'extraction des indices pertinents dans le flux audiovisuel de parole.

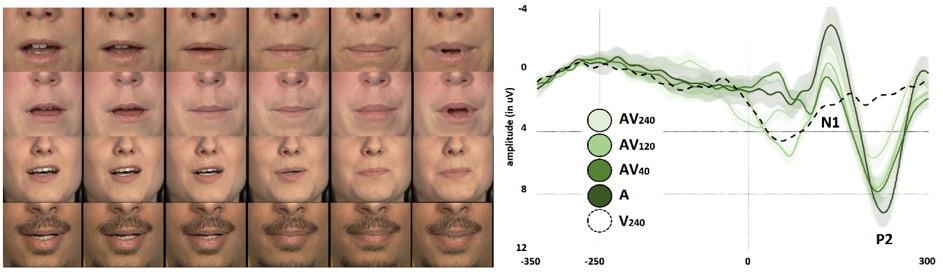

Face à ces résultats, cette étude en électro-encéphalographie avait pour but d'examiner une question simple : dans quelle mesure la durée des gestes pré-phonatoires influence-t-elle les traitements neuraux auditifs subséquents ? À cette fin, des syllabes audiovisuelles ont été présentées à des participants et constituées soit de 240, 120 ou 40 millisecondes des mêmes mouvements visuels pré-phonatoires mais dont la partie initiale avait été tronquée dans le cas des durées de 120 et 40 millisecondes. Malgré des taux de reconnaissance similaires, une modulation des temps de reconnaissance syllabique ainsi que de l'activité électrique des régions auditives , directement fonction de la durée des mouvements visuels, a été observée. Ces résultats soulignent de manière simple l’importance de mécanismes prédictifs lors de la perception audiovisuelle de la parole, la durée des gestes pré-phonatoires visuels influençant de manière quasi-linéaire les traitements acoustico-phonétiques subséquents.

Référence

Sato M. 2022, The timing of visual speech modulates auditory neural processing, Brain and Language, 235: 105196.